|

|

|

|

|

|

|

|

|

|

Prof. Dr. José Mario De Martino

|

|

|

|

|

|

Doutorado

|

|

|

|

|

|

José

Elias Yauri Vidalon Reconhecimento de Sinais Manuais e Não-Manuais de Libras. |

|

|

|

|

|

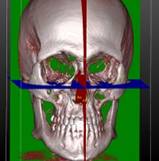

Rodrigo

Mologni Gonçalves dos Santos Resumo: A Cirurgia Ortognática

é um grupo de procedimentos cirúrgicos de competência da Cirurgia e Traumatologia Bucomaxilofacial,

especialidade da Odontologia. Trata as deformidades dentofaciais, que não são possíveis de serem corrigidas

somente pela Ortodontia. A definição do plano de tratamento é a etapa mais

importante destas cirurgias, sendo formada por: 1) análise facial, onde, por

meio do exame físico, são avaliadas e mensuradas as estruturas faciais; 2)

análise cefalométrica, na qual são feitas, em

radiografias padronizadas da cabeça, mensurações dos tecidos duros e moles;

3) traçado de previsão, para a predição do resultado pós-cirúrgico; e 4)

cirurgia de modelos, na qual o ato cirúrgico é simulado, em modelos de gesso

das arcadas dentárias, para o estudo e confecção dos guias cirúrgicos.

Tradicionalmente, estas tarefas são realizadas de modo artesanal. Com o

constante avanço das técnicas computacionais, duas outras metodologias se

apresentaram à disposição da Cirurgia Ortognática:

uma bidimensional (2D) e outra tridimensional (3D). Na abordagem 2D, as duas

primeiras tarefas foram transferidas para o ambiente computacional,

permitindo que os resultados dos movimentos cirúrgicos fossem visualizados na

tela do computador na forma de imagens 2Ds. O maior benefício, trazido pela

abordagem 2D, foi permitir que se pudesse antever os resultados do

procedimento cirúrgico, observando as transformações da imagem fotográfica do

perfil do paciente conforme os deslocamentos ósseos fossem sendo realizados.

A necessidade de manipulação dos modelos das arcadas foi uma das motivações

para o surgimento da tecnologia 3D mais moderna e ainda em desenvolvimento. A

abordagem 3D possibilita que todas as tarefas sejam realizadas em um modelo

anatômico virtual 3D da cabeça do paciente, criado a partir de tomografia

computadorizada. É apresentado neste documento uma proposta de pesquisa

visando o estudo e a aplicação de técnicas de aprendizado de máquina para, a

partir de medidas realizadas sobre o modelo virtual 3D da cabeça do paciente,

sugerir planos de tratamento eficazes. Como resultado, espera-se automatizar

a etapa de movimentação dos segmentos ósseos e assim reduzir

significativamente o tempo gasto pelo especialista com esta atividade,

reduzindo custos, além de aumentar a precisão dos procedimentos. |

|

|

|

|

|

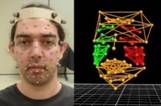

Paula

Dornhofer Paro Costa Resumo: Sistemas

de animação facial sincronizada com a fala podem ser aplicados em interfaces

humano-computador que reproduzem os mecanismos de comunicação face-a-face com os quais estamos naturalmente

familiarizados, representando uma alternativa a interfaces baseadas em janelas,

ícones, menus e dispositivos apontadores. Além disso, cabeças virtuais

animadas podem assumir papéis como: personagens de filmes ou jogos, tutores,

vendedores, assistentes pessoais, recepcionistas e apresentadores de

notícias. Por outro lado,

as expressões faciais, juntamente com a fala e os gestos realizados por

outras partes do corpo, são os meios mais eficazes através dos quais um ser

humano expressa suas intenções, sua postura diante de um assunto, seu estado

emocional interno ou transmite outras mensagens nãoverbais como, por exemplo,

estados físicos de cansaço, doença, fome, etc.. Dessa maneira,

agentes virtuais personificados que inspirem veracidade e confiança devem ser

capazes de reproduzir de maneira convincente as expressões faciais associadas

aos possíveis estados emocionais relevantes a uma determinada aplicação. |

|

|

|

|

|

Wanessa

Machado do Amaral Resumo: Acessibilidade e uma preocupação crescente

em computação. Uma vez que as informações em ambientes computacionais são

apresentadas em sua maioria por meios visuais, pode-se ter a falsa impressão

de que a acessibilidade para deficientes auditivos não e um problema. No

entanto, para pessoas que adquirem a surdez antes da alfabetização, materiais

escritos são, em geral, menos acessíveis do que se apresentados em línguas de

sinais. Para o deficiente auditivo a língua de

sinais e geralmente a primeira língua adquirida, e ler um texto em uma língua

escrita e o equivalente a utilizar uma língua estrangeira. Apesar de um surdo

poder ser fluente em português assim como o ouvinte pode ser fluente em

língua de sinais, a língua oral e escrita comumente não e sua primeira

língua. E possível aprimorar a interação homem-máquina de portadores de

deficiência auditiva adequando as respostas dos sistemas computacionais as

necessidades dos surdos. A libras, língua brasileira de sinais,

utiliza gestos e expressões faciais para a comunicação, sendo utilizada pela

comunidade brasileira de surdos e reconhecida como língua oficial do Brasil.

Para criar conteúdo virtual em língua de sinais, de maneira automática,

faz-se necessária a utilização de uma notação capaz de descrever os sinais.

Sistemas de transcrição foram desenvolvidos para as línguas de sinais. Porém,

uma vez que não foram criados com o intuito de gerar animações por

computador, estes sistemas de transcrição possuem limitação, tais como

ambiguidades ou omissão de informações, dificultando seu uso para os

propósitos deste trabalho. Em geral, o reconhecimento e a reprodução de um

sinal com o uso dos sistemas de transcrições existentes são possíveis apenas

por interpretes experientes ou por profundos conhecedores da notação. Este trabalho propõe um sistema de

transcrição para a reprodução computacional e em tempo real de conteúdo em

língua de sinais através de um agente virtual sinalizador, modelo

tridimensional que representa uma figura humana e que articula os sinais da

libras. Para isso e necessário registrar explicitamente quantidade suficiente

de informações para que a reprodução seja próxima a realidade. Apesar dos

estudos das línguas de sinais existirem por quase meio século, o problema de

transcrição continua um desafio. Dessa forma, a proposta de uma notação para

descrever, armazenar e reproduzir conteúdo em libras por um agente virtual

sinalizador em tempo real oferece uma ferramenta poderosa de estudo e

pesquisa, que contribui para um melhor entendimento da língua brasileira de

sinais, uma vez que ainda se conhece pouco sobre sua estrutura, gramática e

fonética, quando comparado ao conhecimento adquirido ao longo dos séculos

pelos estudos das línguas orais. Tese: pdf. Repercussão

na Mídia: Entrevista Ederson Granetto - Univesp, maio 2012; Jornal da Unicamp, maio 2012; ComCiência, março 2012; Pesquisa Fapesp, março 2012. |

|

|

|

|

|

Mestrado |

|

|

|

|

|

Tiago de Freitas

Pereira |

|

|

|

|

|

Rafael

Guimarães Ramos |

|

|

|

|

|

Enrique

Pimentel Resumo: A análise tática das

mais variadas modalidades esportivas cresce a cada ano, tendo em vista que,

em muitos esportes, a parte tática tornou-se fator determinante para a

vitória. Com as equipes cada vez mais equiparadas

(física e tecnicamente), uma análise tática realizada de forma rápida e

precisa pode auxiliar as equipes a obterem sucesso. O crescimento da prática de esportes

paraolímpicos, como é o caso do Goalball, traz novos desafios às equipes para que

tornem-se vitoriosas, a análise tática é uma delas. Apesar de alguns esportes

paraolímpicos terem essa análise realizada manualmente ou com o auxílio de

softwares criados para outros jogos, esse tipo de necessidade tem aumentado

principalmente em grandes competições e treinamentos para jogos específicos. A análise tática para o Goalball requer

informações individuais dos jogadores, tais como, região de lançamento,

região de defesa, eficiência no ataque e informações coletivas, como formação

de ataque e defesa. Essas informações permitem traçar estratégias para cada

lance da partida, aumentando a possibilidade de sucesso no resultado final. Buscando realizar a análise tática de

maneira automática, são utilizadas

técnicas de processamento de imagens e visão computacional. Para

reduzir o tempo de processamento e

garantir uma análise eficiente, além de trabalhar com algoritmos otimizados,

o presente trabalho também ter por objetivo explorar o poder de processamento

paralelo das GPU's de última geração. |

|

|

|

|

|

Juliano

Renato Bezerra |

|

|

|

|

|

Tatiane

Silva Leite |

|

|

|

|

|

Alex

Garcia Gonçalves Uma das principais características da mensagem de texto é que esta precisa ser lida pelo receptor da mensagem. Tal necessidade, em determinadas situações, pode ser inconveniente, como por exemplo, quando o receptor está dirigindo ou possui dificuldade de leitura, limitação que afeta particularmente pessoas idosas e analfabetas. Como o aparelho celular está disseminado em todas as idades e classes sociais, esse tipo de problema se torna mais comum. O trabalho em questão busca prover uma forma alternativa de comunicação a partir do sistema SMS. No sistema em desenvolvimento um personagem virtual 3D, exibido na tela do celular, apresentará de forma áudio-visual a mensagem textual recebida. O personagem, apresentado na tela do celular, pronunciará o conteúdo da mensagem, reproduzindo a movimentação articulatória visível em sincronia com o áudio. Adicionalmente, o personagem também será capaz de expressar emoções através da movimentação facial. Para a apresentação das emoções, o texto da mensagem deverá ser marcado com os símbolos usualmente utilizados no ambiente da Internet para expressar elementos não-verbais de comunicação, tais como: :-) sorriso ;-) piscada :-D sorriso aberto (-: tristeza, entre outros. O sistema está sendo desenvolvido para celulares que suportam o Sistema Operacional Android. O sistema de animação utiliza a biblioteca OpenGL e o áudio é gerado pelo conversor Texto-Fala Aiuruetê desenvolvido na Unicamp. |

|

|

|

|

|

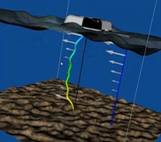

Rodrigo

Mologni Gonçalves dos Santos O objetivo deste projeto de dissertação de mestrado é desenvolver um programa por meio do qual o usuário (especialista em mecânica das ondas) possa visualizar e explorar, de maneira interativa, a propagação de ondas mecânicas descrita em um arquivo de texto gerado pelo Wanglay (um programa desenvolvido no DMC que simula a propagação de ondas mecânicas). Imagens ilustrativas: efeito banda; contorno; vetores Uz; vetores Wz; recorte; contorno por intersecção; vetores normais; trajetória de deslocamento dos pontos; espaço ocupado pela movimentação das ondas; visão estereoscópica por anaglifo. Dissertação: pdf. |

|

|

|

|

|

Paula

Dornhofer Paro Costa Vídeos de demonstração: Palavra; Frase. Sistema Teste: VTTS – Integrado ao CPqD Texto Fala Dissertação: pdf Repercussão na Mídia: Pesquisa Fapesp, julho 2011. |

|

|

|

|

|

Charles

Marcel de Barros Resumo: LIBRAS (Língua

de Sinais Brasileira) é uma língua de modalidade gestual-visual que utiliza

gestos e expressões faciais para a comunicação, sendo reconhecida como a

linguagem natural da comunidade brasileira de surdos. A sua disseminação

exige o ensino e treinamento, assim como, o estímulo para a produção de

material expresso nesta língua. Vídeo tem sido a mídia preferencial para a

produção e a apresentação de material em LIBRAS, entretanto, como o avanço

das técnicas de animação tridimensional por computador, a sinalização

tornou-se viável também para personagens virtuais. Personagens virtuais são

especialmente atrativos em contexto interativos ou caracterizados pela rápida

atualização como, por exemplo, na televisão, Internet ou mesmo em terminais

de atendimento automático. Devido a grande quantidade

de sinais existentes na LIBRAS, o armazenamento dos sinais através de

animação de personagens virtuais se torna interessante. Mesmo quando

utilizado poderosos métodos de compressão, os vídeos continuam com tamanho

superior as animações de personagens virtuais, resultando em um banco de

dados pesado para aplicações sobre a internet, devido à questão de

transferência, como também em dispositivos moveis ou com memória limitada.

Destaca-se também a falta de praticidade para gerar um novo sinal, uma vez

que é necessário capturar o sinal em estúdio. Este processo de aquisição pode

causar complicações, uma vez que para manter a padronização, seria desejável

que uma única pessoa desempenhe todos os sinais. Utilizar pessoas diferentes

pode comprometer ainda mais a transição dos clipes de vídeo que já ocorrem de

forma abrupta. Por sua vez, personagens virtuais possibilitam criar

transições suaves de forma automática e utilizar qualquer personagem sem que

seja necessário recriar todo banco de sinais. Neste âmbito, este projeto ambiciona construir um editor que viabilizará a criação de sinais e desta forma incentivar a produção de trabalhos na área de agentes virtuais sinalizadores LIBRAS. Uma

vez que a leitura de textos pode ser inviável ou demasiadamente desgastante

para os surdos, agentes virtuais podem atuar como uma alternativa ao closed caption em

transmissões da televisão digital ou talvez um tradutor de páginas web. Vídeos de demonstração: Teste de movimentos; Sinal campeão. Repercussão na Mídia: Correio Popular, julho 2006. |

|

|

|

|

|

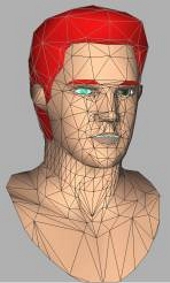

Clausius

Gonçalves dos Reis Resumo:

A modelagem e animação de rugas faciais têm sido tarefas desafiadoras, devido

à variedade de conformações e sutilezas de detalhes que as rugas podem

exibir. Neste trabalho, são descritos dois métodos de apresentação de rugas

em tempo real, utilizando as modernas GPUs. Ambos

os métodos são baseados no uso de shaders e em uma abordagem de normal mapping para aplicar rugas sobre

modelos virtuais. O primeiro método utiliza áreas de influência descritas por

mapas de textura para calcular a exibição de rugas sobre o modelo,

controlados por um "Vetor de Ativação", que informa ao shader a

visibilidade das rugas em cada uma das áreas de influência. O segundo método

apresenta rugas nos modelos faciais, utilizando as informações de

deslocamento dos vértices em direções pré-definidas, informadas através de um

"Vetor Direção de Rugas", que informa o sentido que o deslocamento

de um vértice causa o surgimento de rugas. Dissertação: pdf. Repercussão na Mídia: Correio Popular, julho 2006. |

|

|

|

|

|

Denise

Hippler Vídeos de

demonstração: Com

movimentação não-verbal descoordenada; |

|

|

|

|

|

Renata

Corrêa |

|

|

|

|

|

Iniciação científica |

|

|

|

|

|

Leandro

Martin Guertzenstein Angare Animação Baseada na Manipulação de Segmentos Adquiridos por Captura de Movimento. |

|

|

|

|

Douglas

de Azevedo Fonseca Resumo:

A tecnologia de animação facial é essencial para a

implementação de personagens virtuais personificados capazes de reproduzir o

estilo de comunicação baseado na fala, expressões faciais e gestos, com o

qual os humanos estão habituados. Dependendo da aplicação, estes personagens

virtuais podem desempenhar papéis variados, tais como, por exemplo,

instrutores, assistentes, avatares, apresentadores

ou vendedores. Diversas plataformas hardware/software tem sido utilizadas

para a implementação de tais personagens, incluindo, computadores pessoais,

Web, consoles de jogos e dispositivos móveis. Em particular, a utilização da

tecnologia embarcada em dispositivos móveis é uma opção promissora para

soluções de videotelefonia móvel devido a potencial redução da taxa de

transmissão. Neste cenário, em vez da transmissão do vídeo do interlocutor,

basta a transmissão dos poucos parâmetros necessários para especificar a

locução e as expressões faciais associadas. O presente

trabalho tem como objetivo estudar e aprofundar os conhecimentos associados

`à implementação de sistemas de animações faciais em dispositivos móveis.

Para isso, o projeto propõe migrar para a plataforma móvel o sistema de

animação facial baseado em imagens AnimaFace 2D

desenvolvido no Departamento de Engenharia de Computação e Automação

Industrial da Faculdade de Engenharia Elétrica e de Computação da

Universidade Estadual de Campinas. A partir desta implementação serão

avaliados a performance e o nível de videorrealismo da animação obtidos em

plataforma móvel. |

|

|

|

|

|

|

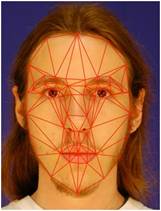

Lucas

Carillho Pessoa Resumo: O trabalho tem por

objetivo estudar, implementar e analisar técnicas para a deteção

e segmentação de regiões em fotografias frontais de rostos. As regiões

faciais de interesse são: contorno do rosto, olhos, sobrancelhas, nariz, boca

e orelhas. Para o desenvolvimento do

trabalho será utilizada base de imagens composta de uma centena de

fotografias digitais, capturadas em ambiente controlado, com iluminação e

fundo constantes.

O trabalho contribuirá para a iniciação do aluno na temática associada

ao processamento, segmentação e reconhecimento de imagens. Também está

previsto que os resultados da iniciação científica sejam aproveitados em

projeto de mestrado em desenvolvimento, que busca identificar parâmetros

faciais associados à atratividade da face para processo automático de

aperfeiçoamento de imagens de rostos. |

|

|

|

|

|

Leandro

Martin Guertzenstein Angare

Ambas as ferramentas deverão ser implementadas de forma que o usuário

tenha controle para definição da hierarquia de dados e atributos (em arquivos

XML) e elaboração de tabelas personalizadas com atributos desejados. Pretende-se também aprofundar o estudo

tanto nas linguagens de programação necessárias para realizar tais tarefas

quanto nas estruturas de dados propostas. |

|

|

|

|

|

Thiago

Cavalcante |

|

|

|

|

|

Tatiane

Silva Leite Resumo: A tecnologia da animação facial é essencial para a

implementação de personagens virtuais personificados

capazes de reproduzir o estilo de comunicação, baseado na fala, expressões

faciais e gestos, com o qual os

humanos estão habituados. Dependendo da aplicação, estes personagens virtuais

podem desempenhar papéis variados, tais como, por exemplo, instrutores,

assistentes, avatares, apresentadores ou

vendedores. Diversas plataformas hardware/software têm sido utilizadas para a

implementaçãoo de tais personagens, incluindo,

computadores pessoais, Web, consoles de jogos e dispositivos móveis. Em

particular, a utilização da tecnologia embarcada em dispositivos móveis é uma

opção promissora para soluçõess de videotelefonia

móvel devido à potencial redução da taxa de transmissão. Neste cenário, em

vez da transmissãoo do vídeo do interlocutor, basta

a transmissão dos poucos parâametros necessáarios para especificar a locução e as expressões

faciais associadas. O presente trabalho tem por objetivo

estudar e aprofundar os conhecimentos associados à implementação de sistemas

de animação facial em dispositivos móveis. O trabalho consiste na migração

para a plataforma J2ME (Java 2 Micro Edition)

de sistema de animação facial desenvolvido no Departamento de Engenharia de

Computação e Automação Industrial da Faculdade de Engenharia Elétrica e de

Computação da Universidade Estadual de Campinas. A versão original foi concebida e

implementada para a plataforma J2SE (Java 2 Standard Edition)

utilizando as APIs JMF (Java Media FrameWork) e Java 3D. No trabalho em proposição será

efetuada a adaptação da solução existente para atender as limitações de

recursos dos dispositivos móveis celulares. |

|

|

|

|

|

Fábio Gabrielli

FernandesIntegração de conversor texto-fala em sistema de animação facial

Financiamento: Bolsa PIBIC/CNPq |

|

|

|

|

|

Rodrigo

Garcia da Silva |

|

|

|

|

|

Anderson

Luiz Brunozi |

|

|

|

|

|

Luciano

Augusto Buniak Pinto Resumo: Desenvolvimento

de software para instalação multimídia interativa, envolvendo o controle da

apresentação de seqüência de imagens através do

reconhecimento de entrada sonora com discriminação da intensidade sonora e

velocidade de produção. O software tem

por finalidade gerenciar a apresentação de um conjunto de imagens através de

“comandos” passados pelo usuário com o auxílio de um instrumento de percursão (surdão). No ambiente

da exposição, o público encontrou uma grande tela onde era projetada o

conteúdo da tela de um computador, e, em frente a esta tela, um surdão com a respectiva baqueta. Batendo o surdão o público pode comandar a apresentação das

imagens. A principal característica do software desenvolvido é a capacidade

de análise e discriminação de sons. A entrada de áudio do computador é

monitorada em tempo real e todas as amostras de som capturadas são analisadas

e, se forem identificadas como o som da batida de um surdão

a mesma é passada para a parte do software responsável pelo gerenciamento das

imagens. Para maior entendimento dos propósitos e concepção do projeto,

consultar o artigo do fotógrafo Fernando de Tacca,

idealizador do projeto, publicada na revista eletrônica Studium. |

|

|

|

|

|

Marcos

Fernando Espíndola |

|

|

|

|

|

Marcos

Fernando Espíndola |

|

|

|

|

|

Miguel

Galvez |

|

|

|

|

|

Sileno

Toledo Rocco Resumo: Desenvolvimento

e implementação de ambiente de auxílio à construção de jogos voltados à

aquisição da fala por deficientes físicos. |

|

|

|

|

|

Paulo

Augusto Dal Fabbro Imagens ilustrativas de técnicas de síntese de

imagem por computador |

|

|

|

|

|

Francis

André S. Esmi Sistema de síntese de imagens baseado na interface

RenderMan - Interpretador RIB Resumo: Projeto

e implementação de sistema de síntese de imagens aderente à especificação

RenderMan™. |

|

|

|

|

|

Leonardo

D. Mattiazi Sistema de síntese de imagens baseado na interface

RenderMan - Gerenciamento de Objetos |

|

|

|

|

|

Luís

Alexandre I. Sant'ana Sistema de síntese de imagens baseado na interface

RenderMan - Gerenciamento do Estado Gráfico |

|

|

|

|

|

Francis

André S. Esmi Sistema de síntese de imagens baseado na interface

RenderMan – Transformações |

|

|

|

|

|

Paulo

Dansa Implementação de um sistema de síntese de imagens

baseado na Interface RenderMan |

|

|

|

|

|

Bolsa trabalho sae |

|

|

|

|

|

Felipe

Lopasso Rodrigues |

|

|

|

|

|

Felipe

Lopasso Rodrigues |

|

|

|

|

|

José

Augusto Ribeiro Resumo:

O contexto do presente trabalho é a implementação de um sistema de síntese

visual da fala, composto pela integração de um conversor texto-fala com um

sistema de animação facial. O sistema de animação facial é controlado pela seqüência de fones produzida pelo conversor, sendo que a

animação é gerada através da concatenação e fusão apropriadas das imagens

armazenadas em um banco de imagens. O banco de imagens é gerado pela

organização e rotulação de imagens extraídas de segmentos de vídeo de um

informante produzindo um acervo de palavras e frases. O projeto em proposição

tem por objetivo a preparação da base de imagens do sistema de animação

facial. |

|

|

|

|

|

Intercâmbio |

|

|

|

|

|

Manuel

SchindlerIntercâmbio: International

Association for the Exchange of Students - IAESTE

País de origem: Alemanha

Início: setembro/2007 Término:

outubro/2007 |

|

|

|

|

|

Roman

Lampert Interface gráfica para o ajuste de parâmetros de

modelos de iluminação de um sistema de visualização baseado no pacote gráfico

RenderMan. Intercâmbio: International Association for the Exchange of Students -

IAESTE

País de origem:

Suíça |

|

|

|

|

|

Michael W. J. MeyerIntercâmbio: International

Association for the Exchange of Students - IAESTE

País de origem: Alemanha

Início: Término: 1995 |

|

|

|

|

|

Bert

H. C. SmeetsIntercâmbio: International

Association for the

Exchange of Students - IAESTE

País de origem:

Holanda |

|

|

|

|

|

|

|

|

|

|

|

Última

atualização setembro 2013

|

|

|

|

|

|

|

|